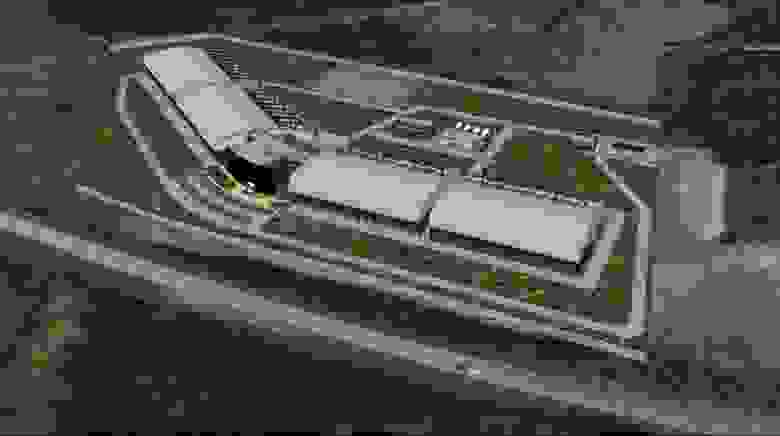

Этой весной мы получили разрешение на эксплуатацию нашего нового дата-центра. Первого, для которого всё, даже здание, команда Яндекса спроектировала и построила с нуля. За те 18 лет, которые люди ищут в интернете Яндексом, мы прошли большой путь от сервера под столом одного из наших разработчиков до постройки дата-центра, где используем оборудование собственной разработки. По дороге у нас появилось несколько дата-центров в России, в которые мы перестроили прекратившие когда-то свою работу заводы и цеха.

Когда мы выбирали место, где можно строить дата-центр с нуля, холодный климат был одним из важнейших факторов. Но именно в процессе этой стройки мы нашли технологическое решение, которое позволяет нам эксплуатировать ДЦ в более теплом климате. Сейчас мы планируем построить наш следующий дата-центр во Владимирской области. И теперь у нас есть все возможности создать в России дата-центр, который станет одним из самых передовых в мире.

В этом посте мы хотим рассказать, как мы проектировали ДЦ, с какими сложностями столкнулась наша команда в процессе строительства, как проходила пуско-наладка, в чем особенности дата-центров Яндекса и как устроена рекуперация тепла, о которой вы уже могли слышать.

Как мы уже рассказывали, архитектура сервисов компании позволяет организовывать резервирование на уровне дата-центров, а не подсистем, что дает бóльшую гибкость при выборе решений и позволяет снизить избыточность систем и соответствующие затраты.

Дата-центр и серверная архитектура проектируются как единая система, поэтому параметры функционирования инженерных систем могут отличаться от общепринятых — можно, в частности, использовать альтернативные источники бесперебойного питания и отказаться от громоздких технических решений по охлаждению за счет расширения допустимого температурного диапазона. Все это ведет к повышению эффективности и понижению совокупной стоимости владения инфраструктурой.

Одна из метрик эффективности работы дата-центра — PUE. Впрочем, говоря о наших ДЦ, мы не собираемся ставить ее во главу угла. Во-первых, нам незачем меряться PUE с коллегами, а во-вторых, существующие разногласия в методике измерения этого параметра не позволяют проводить сравнение даже между нашими собственными ДЦ.

Однако сама сущность параметра PUE исключительно важна для Яндекса. Коммерческие дата-центры могут позволить себе не скупиться на строительство и оснащение, понимая, что в конечном итоге за все заплатит клиент. В нашем случае мы являемся сами себе клиентом, поэтому низкая совокупная стоимость владения ДЦ (ТСО), пожалуй, самый важный критерий при выборе решений в компании.

И конечно же, нашей команде хочется не только увеличивать площади под установку новых стоек, но и чувствовать профессиональную гордость за то, что мы делаем.

До начала проектирования финского дата-центра мы успели построить (и частично закрыть) 10 дата-центров. При строительстве очередного ДЦ мы каждый раз старались использовать наиболее интересные решения, которые появлялись на рынке в тот момент. Это привело к большому разнообразию реализаций, зато теперь позволяет нам выбирать наилучшие решения не на основании рекламных каталогов, а используя накопленный в компании опыт и результаты собственных экспериментов.

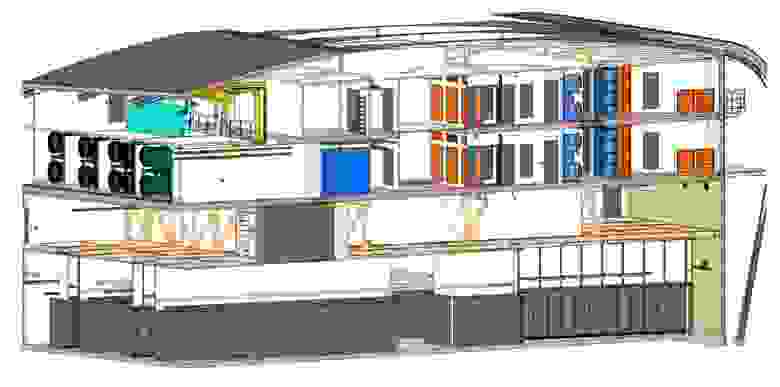

Основная идея, лежащая в проекте финского ДЦ, проста: это применение прямого фрикулинга 100% времени. Прямой фрикулинг (охлаждение серверов наружным воздухом) дает возможность отказаться от использования не только теплообменников с охлажденной водой или другим подходящим теплоносителем, но и от более простых устройств, наподобие колеса Киото, которое стоит в одном из наших ДЦ. В новом дата-центре мы берем воздух с улицы, прогоняем его через серверы и выпускаем на улицу, попутно отбирая часть для смешивания в холодное время года. Наше серверное оборудование сегодня спокойно работает не только в диапазоне 20–24 градуса, который совсем недавно был тем самым разрешенным «окном ASHRAE», но и при более высоких и низких температурах. Поэтому незачем устанавливать капризные и дорогие системы охлаждения, можно просто выбрать регион, в котором среднегодовая температура пониже, а в самые жаркие дни распылять воду, чтобы добавлением влаги снизить на несколько градусов температуру входного воздуха — это называется адиабатическим охлаждением.

Камера адиабатики и каплеуловители за ней

Те из вас, кто изучал конструкцию ДЦ Facebook, которая неоднократно публиковалась в интернете, найдут много аналогий. Но надо сразу оговорить, что это только совпадение. Когда концепт нашего ДЦ был уже готов, нам довелось съездить в гости в один из ДЦ социальной сети, и мы с удивлением узнали, что коллеги только что реализовали проект, практически идентичный нашему.

Конечно же, специфика Орегона и Финляндии повлияла на различия, но принцип обдува воздухом с улицы настолько прост и очевиден, что в сходстве концепций нет ничего удивительного. С другой стороны, мы с удовольствием отметили, что кое в чем наш проект будет даже интереснее.

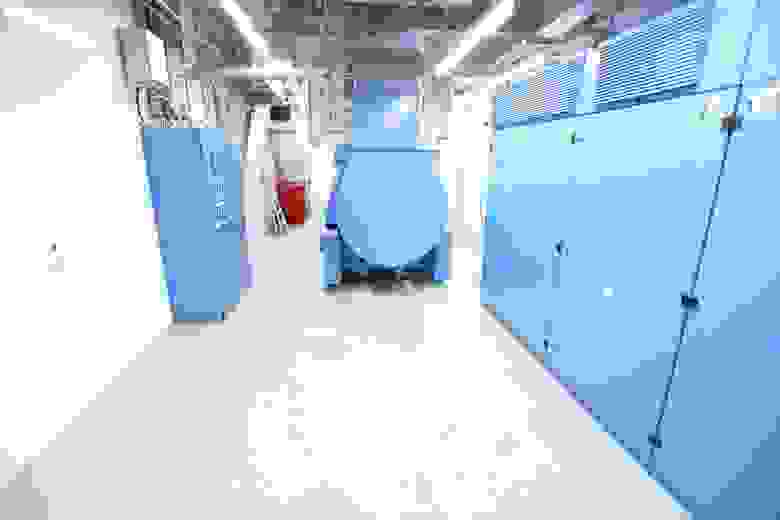

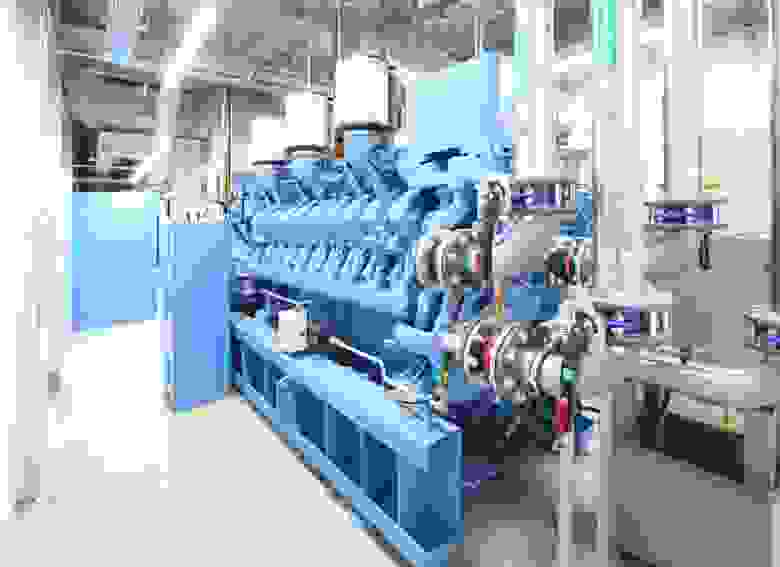

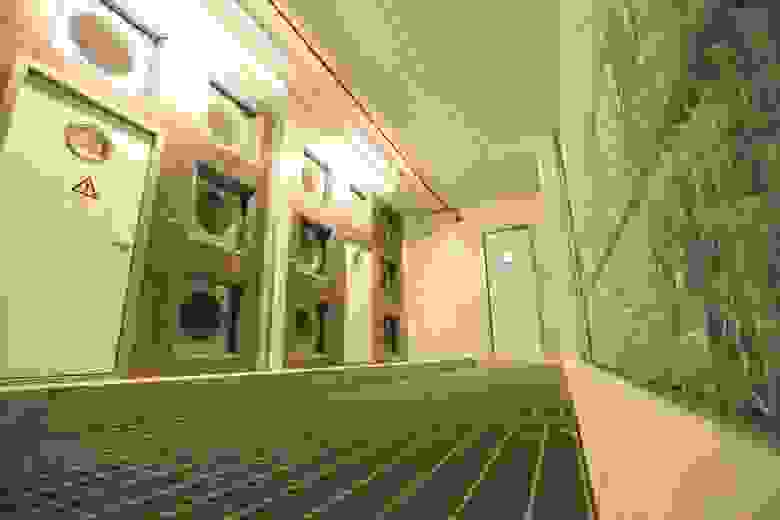

Дизель-генераторы и динамические ИБП

Например, менее сложная система адиабатического охлаждения и использование динамических роторных ИБП (ДРИБП) вместо сочетания дизелей и классических батарейных ИБП.

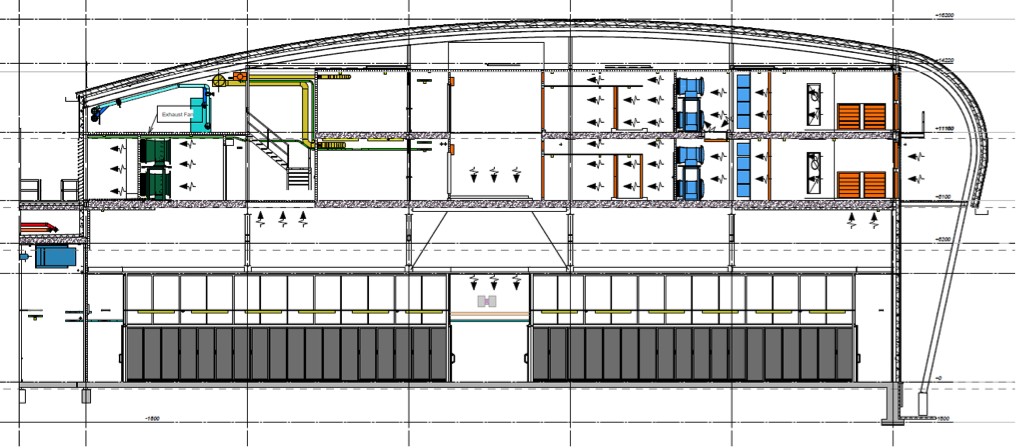

Как видно из иллюстрации, холодный воздух попадает с улицы (с правой стороны картинки) в камеры смешения, откуда после фильтрации нагнетается вентиляторными стенами через модуль увлажнения вниз, в холодные коридоры.

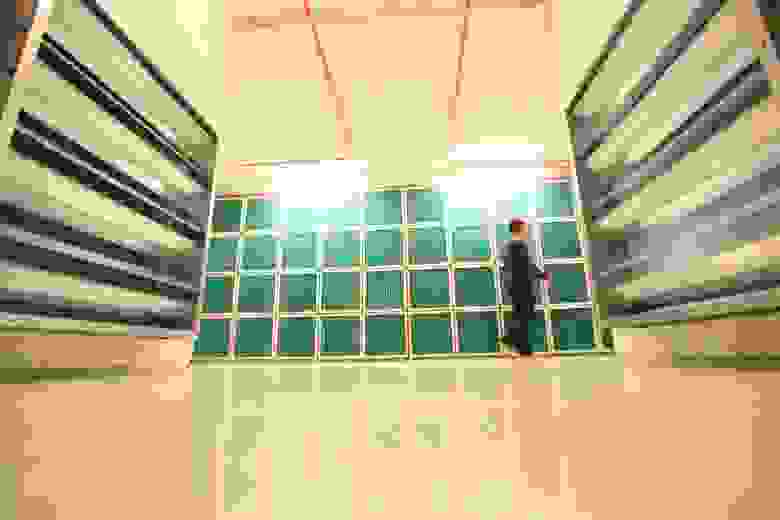

Первый ряд фильтров

Второй ряд фильтров и приточные вентиляторы

Из горячих коридоров воздух попадает в пространство второго этажа, играющего роль своеобразного буфера, откуда часть направляется в камеры смешения.

Камера смешения внешнего и отработанного воздуха для достижения оптимальной температуры

Не используемый в смешении горячий воздух вытяжными вентиляторами выводится с другой стороны здания.

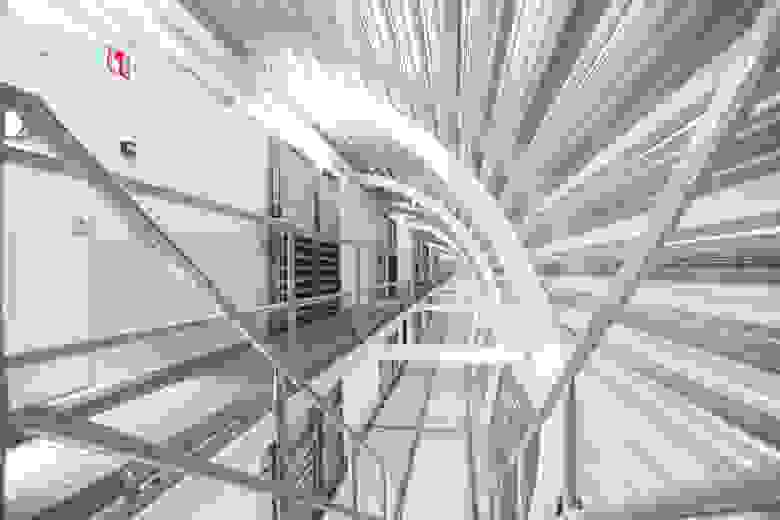

Внутри «горячего коридора»

Решение действительно очень простое, однако оно подразумевает использование оборудования, которое умеет работать при соответствующей температуре и влажности, что трудно достижимо для коммерческих дата-центров.

Серверы в работе

Как показал первый опыт эксплуатации, у нас есть еще значительный потенциал для улучшений. Мы поняли, что можно упростить конструктив здания, полностью отказаться от использования воды в ДЦ и, наконец, расширить географию строительства вплоть до центральных регионов России. Благодаря этому мы сможем построить наш следующий дата-центр во Владимирской области, климат которой значительно теплее финского.

Этот вопрос является вторым по популярности, на который нам приходится отвечать. Ответ же настолько прост, что рассказывать о нем даже немного неловко.

Дело в том, что неофициальным талисманом Яндекса является лось («Наш лось!»). Во всем мире есть две страны, в которых ценят и лелеют этих животных, — Швеция и Финляндия. Но так как в Швеции уже построился Facebook, нам оставались наши северные соседи. Из всей страны мы выбрали город, на гербе которого был лось. Так жребий был брошен, и мы решили строиться в Мянтсяля.

Однако одного лося все же недостаточно. Важнейшими критериями, по которым производился отбор на тот момент, были доступная электрическая мощность (высокостабильная энергосеть Финляндии построена много лет назад для ЦБК, которые чувствительны к качеству питающего напряжения), хорошая доступность оптических линий, жаждущие работы инженеры и, конечно же, холодный северный климат, в условиях которого можно было отказаться от чиллеров и честно использовать любимый фрикулинг.

Нельзя не отметить, что работа с местными партнерами оказалась истинным удовольствием. Так, разрешение на строительство получается в течение одного месяца (sic!), а дорога, линии водо- и теплоснабжения и электропередач возникают на границах участка в невероятно короткие сроки.

Кроме того, мы реализовали с местными властями, так сказать для души, проект по рекуперации тепла. Установив теплообменники в месте выброса отработанного горячего воздуха, мы нагреваем теплоноситель и передаем его в городскую систему теплоснабжения. Для муниципалитета доводить подогретую таким образом воду тепловыми насосами до необходимой температуры оказалось дешевле, чем строить дополнительную котельную для новых районов города.

Собственно теплообменники

Это решение мы представили в марте на выставке CeBit (в этом году объединенной с Datacenter Dynamics), и оно привлекло к себе огромное внимание — тематика энергоэффективных технологий сегодня очень актуальна. 27 мая Мянтсяля получила приз Best Heat Pump City in Europe.

Если не касаться содержания документации, то уже в процессе проектирования мы столкнулись с некоторыми интересными особенностями работы в Финляндии.

Там нет такой жесткой формализации оформления и состава документов, к которой мы привыкли. Говоря совсем просто, детализация документации должна быть ровно такой, чтобы исполнитель смог получить всю необходимую информацию. В какой-то мере облегчило общение с разрешительными органами, которые выражали свое одобрение, основываясь на том, как они поняли документ, не уделяя внимания полноте и оформлению.

Под крышей, где происходит забор воздуха

Некоторые из представителей властей вообще не стремились выразить свое личное мнение о проекте. Пожарный инспектор, например, был удовлетворен, если на представленном пакете документации стояла виза сертифицированной компании-консультанта. Такая подпись для него значила, что проект уже проверен и соответствует всем местным нормативам.

С другой стороны, большинство мелких подрядчиков отказывались даже оценивать стоимость работ, если в чертежах не было прописано все до последнего винтика. Такой подход озадачил не только нас, но и наших партнеров из других стран. В результате очень многие чертежи содержат куда больше информации, чем мы ожидали бы увидеть.

При реализации проекта мы пользовались трехмерной моделью здания, в которой было расставлено все оборудование, проведены кабельные трассы и т. д. На привыкание к этому инструменту потребовалось какое-то время, зато потом работать с моделью оказалось очень удобно — удавалось быстрее решать некоторые проблемы при сведении систем, которые были не сразу очевидны в двухмерном представлении.

Также наши коллеги научили нас пользоваться онлайн-системой сбора комментариев по проекту, так что можно было быть уверенным, что замечания не потеряются и будут регулярно просматриваться на проектных встречах.

О необычайных приключениях русских заказчиков в Финляндии можно было бы написать отдельную большую статью. Но главный вывод прост: успех подобных проектов определяется умением преодолевать различия в менталитете и культуре участников. И самая большая ответственность лежит на нас в момент выбора партнера, который сможет эти различия примирить. Примеров можно привести очень много. Самые забавные, пожалуй, следующие.

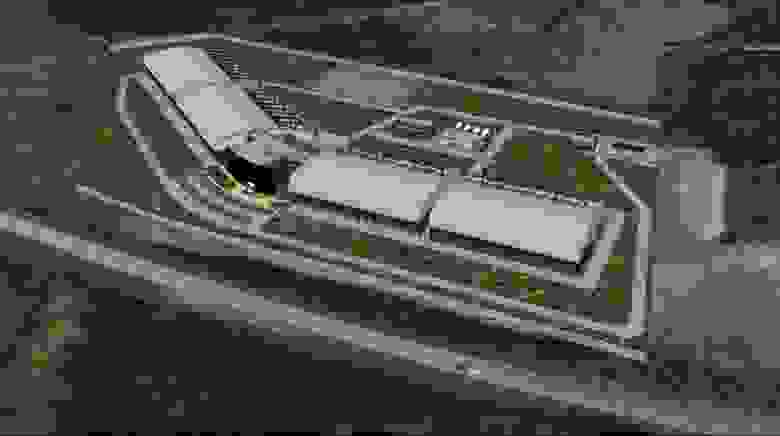

Начало строительства

Финская стройка работает с семи утра до трех-четырех дня. Представьте наше недоумение, когда российская команда, возвращаясь с обеда, видит дружную толпу строителей, уже закончивших на сегодня трудовую вахту. Оставшиеся полдня мы наблюдаем почти пустынную стройплощадку, и на этом фоне несколько странно выглядят заявления финских партнеров, сетующих на то, что они никак не успевают уложиться в сроки, хотя и очень стараются.

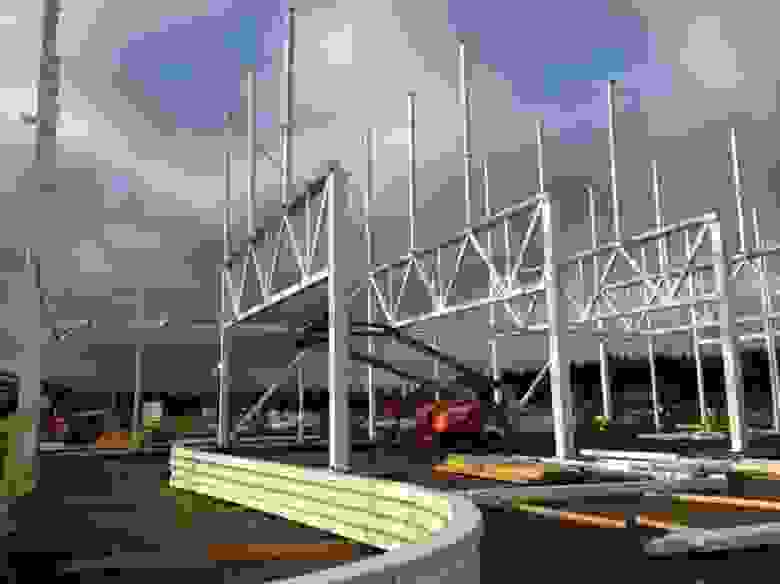

Возведение стальных конструкций

На уровне рядового рабочего финское качество строительства не слишком сильно отличается от привычного нам. Существенное приращение качества происходит при добавлении нескольких уровней профессиональных бригадиров, контролеров и руководителей. И хотя цена «менеджерской составляющей» приводит в шок, результат получается очень хороший.

И конечно, нельзя не упомянуть легендарный финский июль, когда вся страна бросает работу и начинает отдыхать. В некоторые компании бессмысленно даже звонить — в офисе нет ни единой души. Так как мы привыкли считать эти редкие погожие дни идеальным временем для завершения многих строительных работ, такое отношение со стороны подрядчиков для нас выглядело как откровенный саботаж.

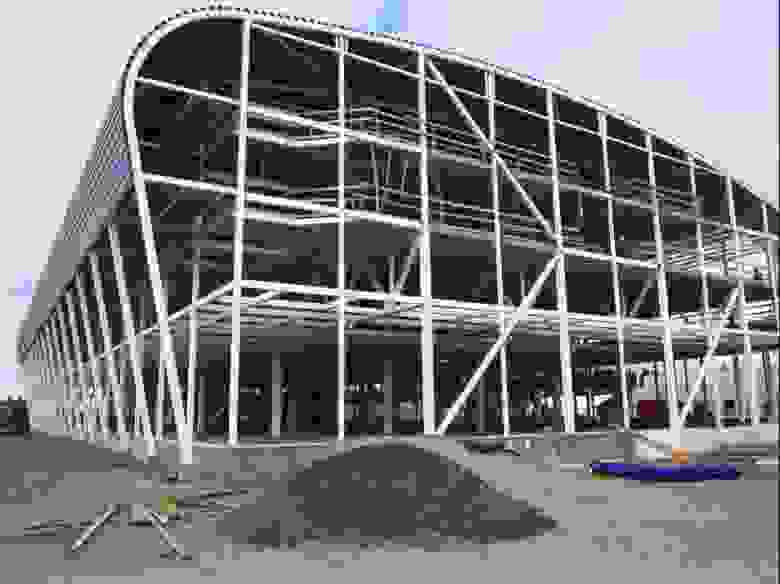

Каркас готов

Но самым главным уроком этого строительства стало осознание того, что проекты такого масштаба требуют совершенно особого подхода. То, как ты организуешь стройку, оказывает несоизмеримо больший эффект на результат проекта, чем то, что ты строишь. Мы увидели, что в другой стране люди работают иначе. Это не значит, что они что-то делают плохо, — просто по-другому. Кажется, нам удалось понять друг друга, и главное, что мы вместе получили отличный результат.

Пожалуй, основное, что отличает этот проект от всех предыдущих, — понимание с самого начала важности полноценной пусконаладки (ПНР). Для качественной сдачи объекта, а следовательно, для минимизации проблем во время эксплуатации мы еще в период проектирования держали в голове целую фазу проекта под названием Commissioning. Скрепя сердце мы отдали Commissioning два месяца, зная, что на эти два месяца будет отложен ввод в эксплуатацию уже готового ДЦ, и одновременно понимая, что в дальнейшем это окупится сторицей. И в самом деле, в процессе пусконаладки было найдено некоторое количество недостатков. Ничего серьезного, но дополнительные хлопоты службе эксплуатации они бы принесли.

Не только российский, но и мировой опыт показывает, что пусконаладка ДЦ — все еще непривычное явление. В лучшем случае разрозненные поставщики приносят программы индивидуальных испытаний, а затем группа эксплуатации совместно с генеральным подрядчиком прогоняет пять-шесть самых критичных ситуаций, как правило связанных с запуском дизелей и переключением вводов.

Полноценное описание процесса заслуживает отдельного рассказа, поэтому здесь только упомянем, что мы запланировали и провели все пять ступеней ПНР с тщательным документированием результатов.

Пусконаладку выполняла специально обученная команда. Формально они были сотрудниками генерального подрядчика, однако фактически действовали независимо, оценивая качество работ, в том числе и своих коллег. Огромное участие в пусконаладке принимала и уже сформированная к тому времени служба эксплуатации. Естественно, и представители московского офиса пристально следили за результатами испытаний.

Такой подход был сравнительно новым для нас. Мы по достоинству оценили его возможности и теперь даже не представляем, как без него запускаться.

Интересно, что набор и подготовку службы эксплуатации мы начали задолго до монтажа инженерных систем. Это позволило нам потратить больше времени на поиск действительно хороших специалистов, частично привлечь их даже на период проектирования: к сожалению, это привело к изменению проекта в самый последний момент, но зато уменьшило оторванность проекта от потребностей живых людей, которые проведут в этом ДЦ не один год. На некоторых этапах пусконаладки служба эксплуатации выполняла тестирование своими силами под наблюдением ответственной стороны.

Вход в офисную часть

В Финляндии большое внимание уделяется вопросам сертификации специалистов — некоторые виды работ выполнять без подтвержденной квалификации просто незаконно. Второй серьезный момент — это соблюдение норм охраны труда и экологии. Поэтому в нашей команде соответствующий специалист появился вторым по счету, и мы могли быть уверены, что не нарушим жесткие нормы законодательства даже случайно. Также значительный временной лаг позволил нам провести все требуемое обучение и сертификацию еще до начала эксплуатации, то есть вообще «без отрыва от производства».

Обратная сторона здания дата-центра

В целом хочется отметить большую заинтересованность будущих дежурных в своей работе. Мы уверены в команде, которую набрали, несмотря на то что дата-центр, тем более такого уровня, большинство ребят увидели в первый раз.

Нельзя не отметить, что теперь департамент эксплуатации Яндекса становится по-настоящему международным коллективом. Это не только позволит компании продолжать развивать новые навыки совместной работы, но и обяжет поднимать планку для уже существующей службы.

Дальше у нас в планах расширение уже построенных площадок, а также строительство нового дата-центра, который обещает быть еще более прогрессивным. Наша цель — сделать его одним из лучших в мире.

Когда мы выбирали место, где можно строить дата-центр с нуля, холодный климат был одним из важнейших факторов. Но именно в процессе этой стройки мы нашли технологическое решение, которое позволяет нам эксплуатировать ДЦ в более теплом климате. Сейчас мы планируем построить наш следующий дата-центр во Владимирской области. И теперь у нас есть все возможности создать в России дата-центр, который станет одним из самых передовых в мире.

В этом посте мы хотим рассказать, как мы проектировали ДЦ, с какими сложностями столкнулась наша команда в процессе строительства, как проходила пуско-наладка, в чем особенности дата-центров Яндекса и как устроена рекуперация тепла, о которой вы уже могли слышать.

Необходимость

Как мы уже рассказывали, архитектура сервисов компании позволяет организовывать резервирование на уровне дата-центров, а не подсистем, что дает бóльшую гибкость при выборе решений и позволяет снизить избыточность систем и соответствующие затраты.

Дата-центр и серверная архитектура проектируются как единая система, поэтому параметры функционирования инженерных систем могут отличаться от общепринятых — можно, в частности, использовать альтернативные источники бесперебойного питания и отказаться от громоздких технических решений по охлаждению за счет расширения допустимого температурного диапазона. Все это ведет к повышению эффективности и понижению совокупной стоимости владения инфраструктурой.

Одна из метрик эффективности работы дата-центра — PUE. Впрочем, говоря о наших ДЦ, мы не собираемся ставить ее во главу угла. Во-первых, нам незачем меряться PUE с коллегами, а во-вторых, существующие разногласия в методике измерения этого параметра не позволяют проводить сравнение даже между нашими собственными ДЦ.

Однако сама сущность параметра PUE исключительно важна для Яндекса. Коммерческие дата-центры могут позволить себе не скупиться на строительство и оснащение, понимая, что в конечном итоге за все заплатит клиент. В нашем случае мы являемся сами себе клиентом, поэтому низкая совокупная стоимость владения ДЦ (ТСО), пожалуй, самый важный критерий при выборе решений в компании.

И конечно же, нашей команде хочется не только увеличивать площади под установку новых стоек, но и чувствовать профессиональную гордость за то, что мы делаем.

Идея

До начала проектирования финского дата-центра мы успели построить (и частично закрыть) 10 дата-центров. При строительстве очередного ДЦ мы каждый раз старались использовать наиболее интересные решения, которые появлялись на рынке в тот момент. Это привело к большому разнообразию реализаций, зато теперь позволяет нам выбирать наилучшие решения не на основании рекламных каталогов, а используя накопленный в компании опыт и результаты собственных экспериментов.

Основная идея, лежащая в проекте финского ДЦ, проста: это применение прямого фрикулинга 100% времени. Прямой фрикулинг (охлаждение серверов наружным воздухом) дает возможность отказаться от использования не только теплообменников с охлажденной водой или другим подходящим теплоносителем, но и от более простых устройств, наподобие колеса Киото, которое стоит в одном из наших ДЦ. В новом дата-центре мы берем воздух с улицы, прогоняем его через серверы и выпускаем на улицу, попутно отбирая часть для смешивания в холодное время года. Наше серверное оборудование сегодня спокойно работает не только в диапазоне 20–24 градуса, который совсем недавно был тем самым разрешенным «окном ASHRAE», но и при более высоких и низких температурах. Поэтому незачем устанавливать капризные и дорогие системы охлаждения, можно просто выбрать регион, в котором среднегодовая температура пониже, а в самые жаркие дни распылять воду, чтобы добавлением влаги снизить на несколько градусов температуру входного воздуха — это называется адиабатическим охлаждением.

Камера адиабатики и каплеуловители за ней

Те из вас, кто изучал конструкцию ДЦ Facebook, которая неоднократно публиковалась в интернете, найдут много аналогий. Но надо сразу оговорить, что это только совпадение. Когда концепт нашего ДЦ был уже готов, нам довелось съездить в гости в один из ДЦ социальной сети, и мы с удивлением узнали, что коллеги только что реализовали проект, практически идентичный нашему.

Конечно же, специфика Орегона и Финляндии повлияла на различия, но принцип обдува воздухом с улицы настолько прост и очевиден, что в сходстве концепций нет ничего удивительного. С другой стороны, мы с удовольствием отметили, что кое в чем наш проект будет даже интереснее.

Дизель-генераторы и динамические ИБП

Например, менее сложная система адиабатического охлаждения и использование динамических роторных ИБП (ДРИБП) вместо сочетания дизелей и классических батарейных ИБП.

Как видно из иллюстрации, холодный воздух попадает с улицы (с правой стороны картинки) в камеры смешения, откуда после фильтрации нагнетается вентиляторными стенами через модуль увлажнения вниз, в холодные коридоры.

Первый ряд фильтров

Второй ряд фильтров и приточные вентиляторы

Из горячих коридоров воздух попадает в пространство второго этажа, играющего роль своеобразного буфера, откуда часть направляется в камеры смешения.

Камера смешения внешнего и отработанного воздуха для достижения оптимальной температуры

Не используемый в смешении горячий воздух вытяжными вентиляторами выводится с другой стороны здания.

Внутри «горячего коридора»

Решение действительно очень простое, однако оно подразумевает использование оборудования, которое умеет работать при соответствующей температуре и влажности, что трудно достижимо для коммерческих дата-центров.

Серверы в работе

Как показал первый опыт эксплуатации, у нас есть еще значительный потенциал для улучшений. Мы поняли, что можно упростить конструктив здания, полностью отказаться от использования воды в ДЦ и, наконец, расширить географию строительства вплоть до центральных регионов России. Благодаря этому мы сможем построить наш следующий дата-центр во Владимирской области, климат которой значительно теплее финского.

Почему Финляндия?

Этот вопрос является вторым по популярности, на который нам приходится отвечать. Ответ же настолько прост, что рассказывать о нем даже немного неловко.

Дело в том, что неофициальным талисманом Яндекса является лось («Наш лось!»). Во всем мире есть две страны, в которых ценят и лелеют этих животных, — Швеция и Финляндия. Но так как в Швеции уже построился Facebook, нам оставались наши северные соседи. Из всей страны мы выбрали город, на гербе которого был лось. Так жребий был брошен, и мы решили строиться в Мянтсяля.

Однако одного лося все же недостаточно. Важнейшими критериями, по которым производился отбор на тот момент, были доступная электрическая мощность (высокостабильная энергосеть Финляндии построена много лет назад для ЦБК, которые чувствительны к качеству питающего напряжения), хорошая доступность оптических линий, жаждущие работы инженеры и, конечно же, холодный северный климат, в условиях которого можно было отказаться от чиллеров и честно использовать любимый фрикулинг.

Нельзя не отметить, что работа с местными партнерами оказалась истинным удовольствием. Так, разрешение на строительство получается в течение одного месяца (sic!), а дорога, линии водо- и теплоснабжения и электропередач возникают на границах участка в невероятно короткие сроки.

Кроме того, мы реализовали с местными властями, так сказать для души, проект по рекуперации тепла. Установив теплообменники в месте выброса отработанного горячего воздуха, мы нагреваем теплоноситель и передаем его в городскую систему теплоснабжения. Для муниципалитета доводить подогретую таким образом воду тепловыми насосами до необходимой температуры оказалось дешевле, чем строить дополнительную котельную для новых районов города.

Собственно теплообменники

Это решение мы представили в марте на выставке CeBit (в этом году объединенной с Datacenter Dynamics), и оно привлекло к себе огромное внимание — тематика энергоэффективных технологий сегодня очень актуальна. 27 мая Мянтсяля получила приз Best Heat Pump City in Europe.

Проектирование

Если не касаться содержания документации, то уже в процессе проектирования мы столкнулись с некоторыми интересными особенностями работы в Финляндии.

Там нет такой жесткой формализации оформления и состава документов, к которой мы привыкли. Говоря совсем просто, детализация документации должна быть ровно такой, чтобы исполнитель смог получить всю необходимую информацию. В какой-то мере облегчило общение с разрешительными органами, которые выражали свое одобрение, основываясь на том, как они поняли документ, не уделяя внимания полноте и оформлению.

Под крышей, где происходит забор воздуха

Некоторые из представителей властей вообще не стремились выразить свое личное мнение о проекте. Пожарный инспектор, например, был удовлетворен, если на представленном пакете документации стояла виза сертифицированной компании-консультанта. Такая подпись для него значила, что проект уже проверен и соответствует всем местным нормативам.

С другой стороны, большинство мелких подрядчиков отказывались даже оценивать стоимость работ, если в чертежах не было прописано все до последнего винтика. Такой подход озадачил не только нас, но и наших партнеров из других стран. В результате очень многие чертежи содержат куда больше информации, чем мы ожидали бы увидеть.

При реализации проекта мы пользовались трехмерной моделью здания, в которой было расставлено все оборудование, проведены кабельные трассы и т. д. На привыкание к этому инструменту потребовалось какое-то время, зато потом работать с моделью оказалось очень удобно — удавалось быстрее решать некоторые проблемы при сведении систем, которые были не сразу очевидны в двухмерном представлении.

Также наши коллеги научили нас пользоваться онлайн-системой сбора комментариев по проекту, так что можно было быть уверенным, что замечания не потеряются и будут регулярно просматриваться на проектных встречах.

Строительство

О необычайных приключениях русских заказчиков в Финляндии можно было бы написать отдельную большую статью. Но главный вывод прост: успех подобных проектов определяется умением преодолевать различия в менталитете и культуре участников. И самая большая ответственность лежит на нас в момент выбора партнера, который сможет эти различия примирить. Примеров можно привести очень много. Самые забавные, пожалуй, следующие.

Начало строительства

Финская стройка работает с семи утра до трех-четырех дня. Представьте наше недоумение, когда российская команда, возвращаясь с обеда, видит дружную толпу строителей, уже закончивших на сегодня трудовую вахту. Оставшиеся полдня мы наблюдаем почти пустынную стройплощадку, и на этом фоне несколько странно выглядят заявления финских партнеров, сетующих на то, что они никак не успевают уложиться в сроки, хотя и очень стараются.

Возведение стальных конструкций

На уровне рядового рабочего финское качество строительства не слишком сильно отличается от привычного нам. Существенное приращение качества происходит при добавлении нескольких уровней профессиональных бригадиров, контролеров и руководителей. И хотя цена «менеджерской составляющей» приводит в шок, результат получается очень хороший.

И конечно, нельзя не упомянуть легендарный финский июль, когда вся страна бросает работу и начинает отдыхать. В некоторые компании бессмысленно даже звонить — в офисе нет ни единой души. Так как мы привыкли считать эти редкие погожие дни идеальным временем для завершения многих строительных работ, такое отношение со стороны подрядчиков для нас выглядело как откровенный саботаж.

Каркас готов

Но самым главным уроком этого строительства стало осознание того, что проекты такого масштаба требуют совершенно особого подхода. То, как ты организуешь стройку, оказывает несоизмеримо больший эффект на результат проекта, чем то, что ты строишь. Мы увидели, что в другой стране люди работают иначе. Это не значит, что они что-то делают плохо, — просто по-другому. Кажется, нам удалось понять друг друга, и главное, что мы вместе получили отличный результат.

Пусконаладка

Пожалуй, основное, что отличает этот проект от всех предыдущих, — понимание с самого начала важности полноценной пусконаладки (ПНР). Для качественной сдачи объекта, а следовательно, для минимизации проблем во время эксплуатации мы еще в период проектирования держали в голове целую фазу проекта под названием Commissioning. Скрепя сердце мы отдали Commissioning два месяца, зная, что на эти два месяца будет отложен ввод в эксплуатацию уже готового ДЦ, и одновременно понимая, что в дальнейшем это окупится сторицей. И в самом деле, в процессе пусконаладки было найдено некоторое количество недостатков. Ничего серьезного, но дополнительные хлопоты службе эксплуатации они бы принесли.

Не только российский, но и мировой опыт показывает, что пусконаладка ДЦ — все еще непривычное явление. В лучшем случае разрозненные поставщики приносят программы индивидуальных испытаний, а затем группа эксплуатации совместно с генеральным подрядчиком прогоняет пять-шесть самых критичных ситуаций, как правило связанных с запуском дизелей и переключением вводов.

Полноценное описание процесса заслуживает отдельного рассказа, поэтому здесь только упомянем, что мы запланировали и провели все пять ступеней ПНР с тщательным документированием результатов.

Пусконаладку выполняла специально обученная команда. Формально они были сотрудниками генерального подрядчика, однако фактически действовали независимо, оценивая качество работ, в том числе и своих коллег. Огромное участие в пусконаладке принимала и уже сформированная к тому времени служба эксплуатации. Естественно, и представители московского офиса пристально следили за результатами испытаний.

Такой подход был сравнительно новым для нас. Мы по достоинству оценили его возможности и теперь даже не представляем, как без него запускаться.

Эксплуатация

Интересно, что набор и подготовку службы эксплуатации мы начали задолго до монтажа инженерных систем. Это позволило нам потратить больше времени на поиск действительно хороших специалистов, частично привлечь их даже на период проектирования: к сожалению, это привело к изменению проекта в самый последний момент, но зато уменьшило оторванность проекта от потребностей живых людей, которые проведут в этом ДЦ не один год. На некоторых этапах пусконаладки служба эксплуатации выполняла тестирование своими силами под наблюдением ответственной стороны.

Вход в офисную часть

В Финляндии большое внимание уделяется вопросам сертификации специалистов — некоторые виды работ выполнять без подтвержденной квалификации просто незаконно. Второй серьезный момент — это соблюдение норм охраны труда и экологии. Поэтому в нашей команде соответствующий специалист появился вторым по счету, и мы могли быть уверены, что не нарушим жесткие нормы законодательства даже случайно. Также значительный временной лаг позволил нам провести все требуемое обучение и сертификацию еще до начала эксплуатации, то есть вообще «без отрыва от производства».

Обратная сторона здания дата-центра

В целом хочется отметить большую заинтересованность будущих дежурных в своей работе. Мы уверены в команде, которую набрали, несмотря на то что дата-центр, тем более такого уровня, большинство ребят увидели в первый раз.

Нельзя не отметить, что теперь департамент эксплуатации Яндекса становится по-настоящему международным коллективом. Это не только позволит компании продолжать развивать новые навыки совместной работы, но и обяжет поднимать планку для уже существующей службы.

Что дальше?

Дальше у нас в планах расширение уже построенных площадок, а также строительство нового дата-центра, который обещает быть еще более прогрессивным. Наша цель — сделать его одним из лучших в мире.