На маленькой улице поблизости от набережной Обводного канала стоит здание, выделяющееся лишь загадочной конструкцией на крыше.

После конференции «InfoTrans 2013» мне удалось побывать там, где не ступала нога журналиста, — в Санкт-Петербургском Информационно-вычислительном центре РЖД. Это один из трёх больших датацентров РЖД, управляющих всеми железными дорогами страны.

В информационно-вычислительном центре работает множество различных служб и диспетчерских, во многих из которых дежурство ведётся круглосуточно. Это диспетчерские линий связи, систем продажи билетов, центра обработки данных, колл-центры поддержки пассажиров и служб железной дороги.

Центр управляет всеми процессами автоматизации железной дороги — от продажи билетов до управления движением поездов и учёта перевозимых грузов.

В ЦОД консолидированы четыре крупных комплекса:

• АСОУП — автоматизированная система оперативного управления перевозками, предоставляющая оперативную информацию по нахождению и состоянию локомотивов, вагонов, контейнеров, локомотивных бригад. В неё входит также отдельная система АСУ ГП — грузовые перевозки пяти железных дорог.

• Экспресс — комплекс продажи билетов 12 дорог (Северо-запад, Сибирь, Урал).

• АСУ ФР — финансовые ресурсы восьми дорог.

• АСУ ТР — трудовые ресурсы восьми дорог.

Кроме того в центре работают системы АСУ Т — операции с локомотивами, АСУ Станции — формирование и отправка составов, распределение движения составов по путям.

Здесь обрабатываются все операции по продаже билетов трёх регионов — Северо-западного, Уральского и Сибирского.

Продажа билетов через кассы и интернет сейчас обслуживает одна и та же система. Вот так выглядит терминал кассира. Такие установлены во всех железнодорожных кассах страны.

Интересно, что авторизация кассира происходит по ключу Touch Memory. Точно такие же ключи используются в домофонах.

Диспетчерская линий связи. За шумонепроницаемой стеной, сделанной из обычных пластиковых окон и дверей, расположено оборудование, обеспечивающее связь датацентра с другими вычислительными центрами и объектами РЖД по всей России.

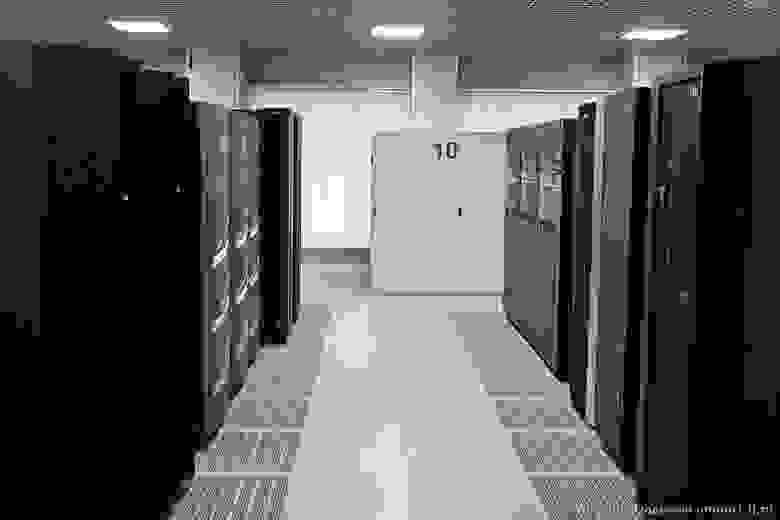

Сердце любого датацентра — серверный зал.

Здесь установлено более пятидесяти серверных стоек с мейнфреймами, блейдсерверами, накопителями, системами резервного копирования и сетевым оборудованием. Зал был построен в 2007 году, но постоянно дооснащается новым оборудованием.

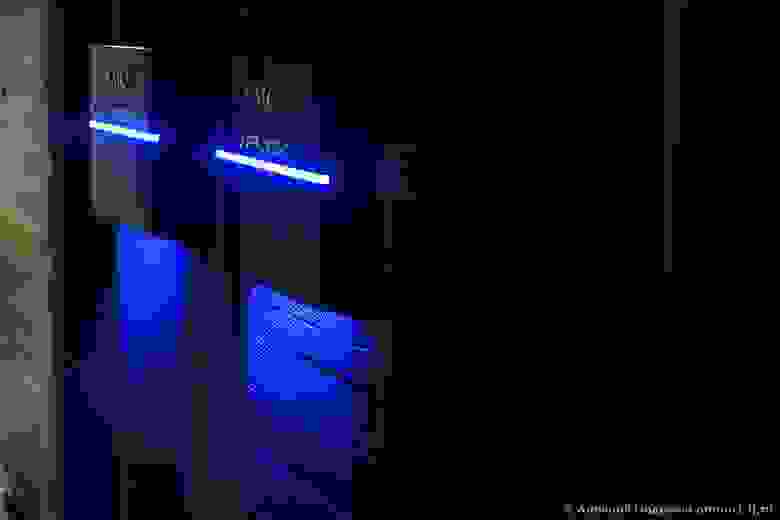

Гордость датацентра — мейнфреймы IBM Z196, установленные в прошлом году. Мощь этих компьютеров такова, что в каждой стойке даже размещена своя дополнительная система кондиционирования. Кстати, это первые Z196, установленные в России.

Интересное наблюдение: в последние годы у серверных стоек, которые почти никто никогда не видит, появился дизайн. Теперь многие из них не серые шкафы, а практически произведения искусства.

Из глубин ЦОДа появляется классический сисадмин с клавиатурой в руках.

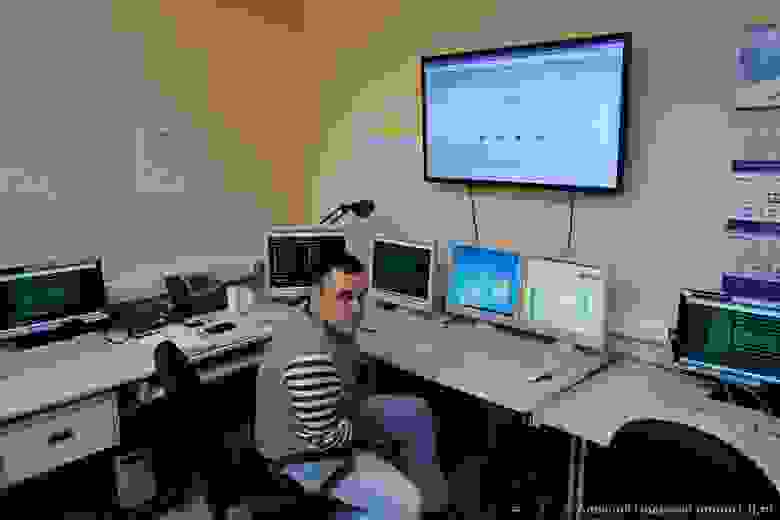

Работу серверного зала непрерывно контролируют два диспетчера.

Все важные системы дублируются и при сбое нагрузка может быть быстро перенесена на резервные сервера. Команда диспетчеров регулярно тренируется, перенося нагрузку на резервные системы в тестовом режиме.

Я побывал в нескольких датацентрах в разных городах нашей страны, и каждый раз восхищаюсь людьми, которые изобрели системы такой сложности и мощи, а ещё восхищаюсь людьми, которые заставляют такие системы работать и понимают, как это всё работает.

После конференции «InfoTrans 2013» мне удалось побывать там, где не ступала нога журналиста, — в Санкт-Петербургском Информационно-вычислительном центре РЖД. Это один из трёх больших датацентров РЖД, управляющих всеми железными дорогами страны.

В информационно-вычислительном центре работает множество различных служб и диспетчерских, во многих из которых дежурство ведётся круглосуточно. Это диспетчерские линий связи, систем продажи билетов, центра обработки данных, колл-центры поддержки пассажиров и служб железной дороги.

Центр управляет всеми процессами автоматизации железной дороги — от продажи билетов до управления движением поездов и учёта перевозимых грузов.

В ЦОД консолидированы четыре крупных комплекса:

• АСОУП — автоматизированная система оперативного управления перевозками, предоставляющая оперативную информацию по нахождению и состоянию локомотивов, вагонов, контейнеров, локомотивных бригад. В неё входит также отдельная система АСУ ГП — грузовые перевозки пяти железных дорог.

• Экспресс — комплекс продажи билетов 12 дорог (Северо-запад, Сибирь, Урал).

• АСУ ФР — финансовые ресурсы восьми дорог.

• АСУ ТР — трудовые ресурсы восьми дорог.

Кроме того в центре работают системы АСУ Т — операции с локомотивами, АСУ Станции — формирование и отправка составов, распределение движения составов по путям.

Здесь обрабатываются все операции по продаже билетов трёх регионов — Северо-западного, Уральского и Сибирского.

Продажа билетов через кассы и интернет сейчас обслуживает одна и та же система. Вот так выглядит терминал кассира. Такие установлены во всех железнодорожных кассах страны.

Интересно, что авторизация кассира происходит по ключу Touch Memory. Точно такие же ключи используются в домофонах.

Диспетчерская линий связи. За шумонепроницаемой стеной, сделанной из обычных пластиковых окон и дверей, расположено оборудование, обеспечивающее связь датацентра с другими вычислительными центрами и объектами РЖД по всей России.

Сердце любого датацентра — серверный зал.

Здесь установлено более пятидесяти серверных стоек с мейнфреймами, блейдсерверами, накопителями, системами резервного копирования и сетевым оборудованием. Зал был построен в 2007 году, но постоянно дооснащается новым оборудованием.

Гордость датацентра — мейнфреймы IBM Z196, установленные в прошлом году. Мощь этих компьютеров такова, что в каждой стойке даже размещена своя дополнительная система кондиционирования. Кстати, это первые Z196, установленные в России.

Интересное наблюдение: в последние годы у серверных стоек, которые почти никто никогда не видит, появился дизайн. Теперь многие из них не серые шкафы, а практически произведения искусства.

Из глубин ЦОДа появляется классический сисадмин с клавиатурой в руках.

Работу серверного зала непрерывно контролируют два диспетчера.

Все важные системы дублируются и при сбое нагрузка может быть быстро перенесена на резервные сервера. Команда диспетчеров регулярно тренируется, перенося нагрузку на резервные системы в тестовом режиме.

Я побывал в нескольких датацентрах в разных городах нашей страны, и каждый раз восхищаюсь людьми, которые изобрели системы такой сложности и мощи, а ещё восхищаюсь людьми, которые заставляют такие системы работать и понимают, как это всё работает.