Microsoft подтвердила, что обновление для Windows Server 2022 (KB5031364) вызывает появление синих экранов смерти (BSOD) на гипервизорах VMware ESXi, работающих на серверных процессорах Amd EPYC. При этом появляется код ошибки «PNP DETECTED FATAL ERROR».

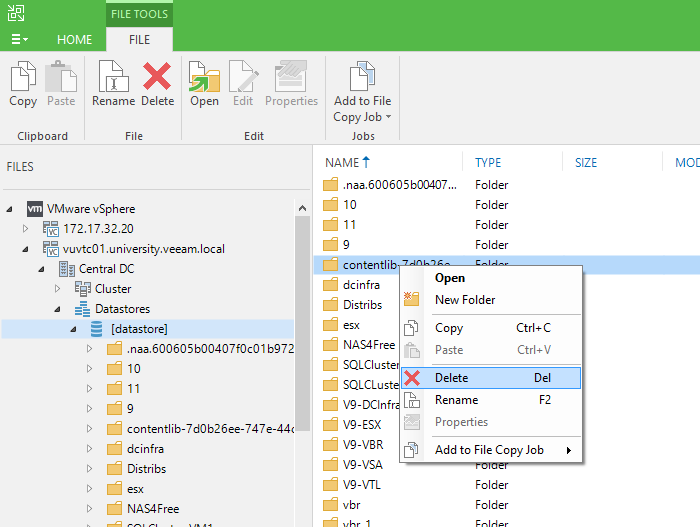

Спасти содержимое vCenter Content Library

Начиная с шестой версии, в VMware vSphere есть удобная фича, позволяющая следить за актуальностью виртуальной инфраструктуры на удалённых площадках и филиалах, насаждая огнём и мечом стандарты виртуальной инфраструктуры главного офиса. Называется она Content Library и занимается распространением шаблонов между вашими дата центрами.

Для чего это надо? Ну, самый банальный пример — у вас есть набор истинно верных и благословлённых всеми службами шаблонов виртуальных машин, из которых должно деплоиться всё в вашей организации. То, что они есть лично на вашем хосте в центральном офисе, ещё не значит, что все остальные получат их вовремя, их версия будет актуальной и на местах не придётся городить свои огороды. Поэтому вы просто подписываете ваши филиалы на обновления из головного офиса, и администраторы удалённых площадок всегда будут иметь доступ к необходимым шаблонам. Очень удобно.

В Content Library можно ещё добавлять сопутствующие файлы, образы дисков и многое другое, но мы сегодня поговорим не про это. Несмотря на три года за плечами, всё ещё многие задаются вопросом “Как бекапить объекты внутри Content Library?”. Там лежат совершенно обычные файлы, с которыми точно так же может случиться любая беда, но доступа к ним через обычные варианты резервного копирования для виртуальных сред нет. Поэтому отвечаем под катом на столь важный вопрос...

VyOS OpenSource Router

Ключевые проекты

VyOS это opensource проект на базе Debian Linux, который родился как форк от проекта Vyatta Core Edition of the Vyatta Routing software. Как и любой роутер VyOS оперирует на третьем уровне OSI и маршрутизирует North-South трафик. VyOS включает в себя следующие ключевые проекты:

- Debian 8, ядро 4.19

- FRRouting (в версии 1.1 и более древних использовался Quagga)

- ISC-DHCP

- Keepalived

- StrongSwan

- OpenVPN

- PowerDNS

- Wireguard

- OpenNHRP

- Accel-ppp

- xL2tpd

- Squid

- mDNS-repeater

- IGMP-Proxy

- iPerf

- более детальный список в Release notes

Samba в роли ADDC в Solaris 11.4

Введение

Когда я в первые установил пакет Samba в Solaris, выяснилось, что роли ADDC в данном пакете нету. Долгие поиски в интернете привели меня к ответам такого рода — пакет Samba в Solaris эту роль не поддерживает, а на некоторых писали о том, что данную роль вообще невозможно реализовать в Solaris. Дальнейшее исследование привели меня к тому, что всё упирается в отсутствие в zfs Posix ACL, а также в python который используется в Solaris. Для решения данных проблем необходимо использовать жёсткий диск с файловой системой ufs, а также собрать из исходного кода python(а также Samba).

Как найти проблему с производительностью ВМ на VMware ESXi

В этой статье я расскажу, как искать иголку в стоге сена причину проблем с производительностью ВМ на ESXi. Главным способом будет то, что так не любят многие администраторы: планомерная проверка всех ресурсов на утилизацию, сатурацию и ошибки. Я приведу ключевые метрики, на которые следует обратить внимание, их краткое описание и значения, на которые можно ориентироваться, как на норму.

Кроме своих наработок, я также использовал материалы из разных англоязычных источников. По некоторым вопросам описания тянули на отдельные статьи, поэтому на них я дал ссылки.

Мал золотник, да дорог: в двух словах о VMware Host Client

Не так давно VMware анонсировали выход VMware Host Client 1.0 одновременно с релизом vSphere 6.0 Update 2. VMware Host Client 1.0 позволяет использовать браузер на HTML 5 для управления индивидуальным хостом ESXi. Использоваться он может на любой ОС — Windows, OS X, Android или других ОС, поддерживающих браузер на HTML 5. До этого релиза для доступа к ESXi хосту требовался запуск на Windows «родного» клиента vSphere. Предлагаем краткий обзор процесса установки и основные фишки клиента.

6 способов поддержания актуальности VM Tools

Когда речь идет о поддержании самых новых версий VM Tools (набора утилит для увеличения производительности виртуальных машин) существует 6 разных способов, которые могут использовать администраторы vSphere. Эти способы обеспечивают оптимизацию для процессов автоматизации, стандартизации и разделения обязанностей.

NetApp ONTAP & ESXi 6.х тюнинг

Эта статья будет полезна владельцам систем хранения с ONTAP, а часть про Disk Alignment будет полезна не только владельцам NetApp`а.

Для поиска узкого места обычно выполняют методику последовательного исключения. Предлагаю перво-наперво начать с СХД. А дальше двигаться СХД -> Сеть (Ethernet / FC) -> Хост ( Windows / Linux / VMware ESXi ) -> Приложение.

Бесплатные утилиты для бэкапа с бесплатного ESXI

Через некоторое время, с развитем проектов, я стал настраивать админские фишки — мониторинг, бэкап, и выяснил, что оказывается сервер, в котором мне обещали Soft RAID, и на который хостер (OVH) накатил свой образ ESXI — без RAID! То есть просто 2 диска. Ну да, теперь вот я знаю, что ESXI не поддерживает Soft RAID, только Hard. Стало неуютно. Да и 2TB стало не хватать. В общем взял я себе сервер побольше, с аппаратным RAID и поставил туда ESXI 6.0.

И возникло две задачи, решение которых я тут опишу:

- Перенести виртуальные машины (некоторые из которых около 1TB) с одного сервера на другой с минимальным оффлайном

- Делать регулярные бэкапы

Скажу сразу, что обе эти задачи легко решаются, если есть хотя бы минимальная платная лицензия ESXI. Дело в том, что «родной» Backup API в бесплатной версии ESXI выключен. Поэтому приходится находить другие пути.

С платной лицензией есть вариант миграции через vCenter. Ещё есть бесплатная версия Veeam Backup, которая позволяет делать бэкапы и переносить виртуальные машины с одной системы на другую и при этом не требуется их останавливать. Но с бесплатной лицензией ESXI, текущая версия — Veeam 9 — не работает вообще.

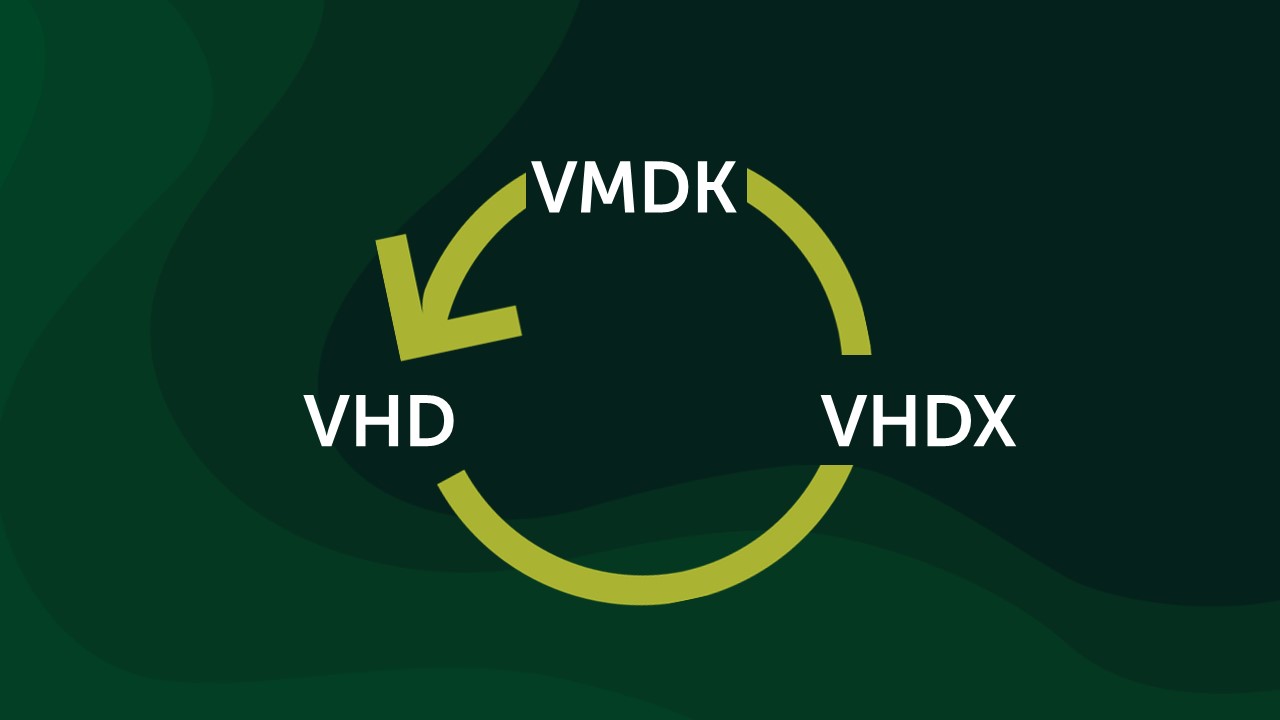

С Hyper-V на VMware и обратно: конвертация виртуальных дисков

Привет, Хабр!

Периодически я слышу от практикующих инженеров странное: VMDK, VHD и VHDX – абсолютно разные форматы виртуальных дисков, чуть ли не закрытые, а конвертировать из одного в другое – долго и больно. Сегодня наглядно покажу, что это не так, разберу, как эти форматы соотносятся друг с другом и как делать быструю конвертацию при миграции с Hyper-V на VMware и обратно.

Немного теории. C точки зрения свойств, виртуальные диски делятся на два типа:

- тонкие (thin disk, dynamic disk) и

- толстые (thick disk, fixed disk). Все остальное — разностные, thick provisioned lazy- zeroed – лишь вариации на тему.

Новое железо или тонкости интеграции RoCEv2 в VMware vSAN ESA

В этом году руководство приняло решение обновлять железо в серверной. Но, с учетом уго древности, требовалось обновить если не всё, то почти всё.

На момент принятия решения об обновлении мы имели полку HP C3000 с блэйд серверами g6-g7 поколений, подключенную к дисковым хранилищам, через ethernet 1GbE аплинки. Дисковые хранилища с sas 10k без кэша. Все это добро работало по iSCSI протоколу, на блэйд серверах были старенькие ESXi. Из нагрузки имелось порядка 70-80 vm разной направленности - начиная от 1С с базами данных до высоконагруженных сервисов. Признаюсь, я умолчал о standalone сервере на nvme под сверх нагруженный сервис, но об этом, может, расскажу позже, если статья зайдет.

Итак. Хотелось чего то современного, быстрого, чтоб аж волосики назад, желательно на nvme дисках и не сильно бьющее по бюджету организации. Ну и надежного, как без этого.

В итоге согласовали покупку 4 серверов hp dl360g10 в nvme исполнении backplane, сетевых карт 2*25GbE, свитчей mellanox SN2410-CB2FC, nvme дисков с минимум 3 DWPD. Всё оборудование с поддержкой RDMA/RoCE.

О том, как всё это новое добро настраивалось и какие решения были приняты далее.

Десктоп в домашнем сервере или «всё-в-одном»

Цель: недорого собрать систему поддерживающую проброс PCI-устройств в виртуальную машину (c IOMMU). Создать полноценное рабочее место, поднять виртуальный маршрутизатор и еще полезные мелочи.

Уязвимости гипервизора – угроза виртуальной инфраструктуре и облаку

При переходе от физической инфраструктуры к виртуальной возникает множество новых угроз. При расширении виртуализации до облака их список расширяется, а возможный ущерб от их эксплуатации многократно возрастает. В этой статье хотелось бы поговорить про одну из основных «новых» угроз в виртуальной среде – уязвимости гипервизора.

При переходе от физической инфраструктуры к виртуальной возникает множество новых угроз. При расширении виртуализации до облака их список расширяется, а возможный ущерб от их эксплуатации многократно возрастает. В этой статье хотелось бы поговорить про одну из основных «новых» угроз в виртуальной среде – уязвимости гипервизора. Рассмотрим основные классы уязвимостей гипервизоров на примере VMware vSphere и возможные пути защиты от их эксплуатации.

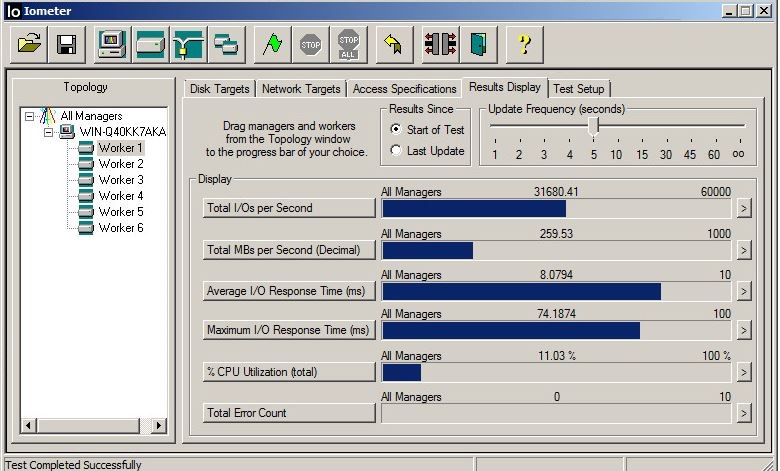

Тестирование СХД NetApp FAS при помощи генератора нагрузки IOMeter

Целью данной статьи помощь системным администраторам и системным интеграторам в понимании настроек и нюансов при тестировании СХД NetApp. Хочу также отметить, что в этой статье не было задачи в получении максимально возможной производительности контроллеров NetApp FAS 2240, так как на момент тестирования демо оборудования не было достаточного количества дисков (144 максимум) для СХД, а также в наличии был только один сервер. Т.е. максимальная производительность здесь рассматривается в контексте конкретной конфигурации демо стенда, другими словами при большем количестве дисков, серверов и подключений по сети возможно получить результаты ещё лучше с теми же контроллерами 2240. Хотя все графики с результатами производительности взяты с реальных конфигураций конечных заказчиков, использующих в тестах контроллеры 2240, в некоторых тестах использовались четыре SSD 100GB MLC диска.

Ниже приведено комплексное описание нагрузочного тестирования СХД: настройки симулятора нагрузки IOMeter, методика настройка хоста и СХД NetApp FAS, снятие статистики нагрузки, а также интерпретация полученных результатов. На примере существующего демо стенда будет рассмотрены методы настройки всех его компонент, а также других возможных вариантов конфигураций с использованием NetApp FAS.

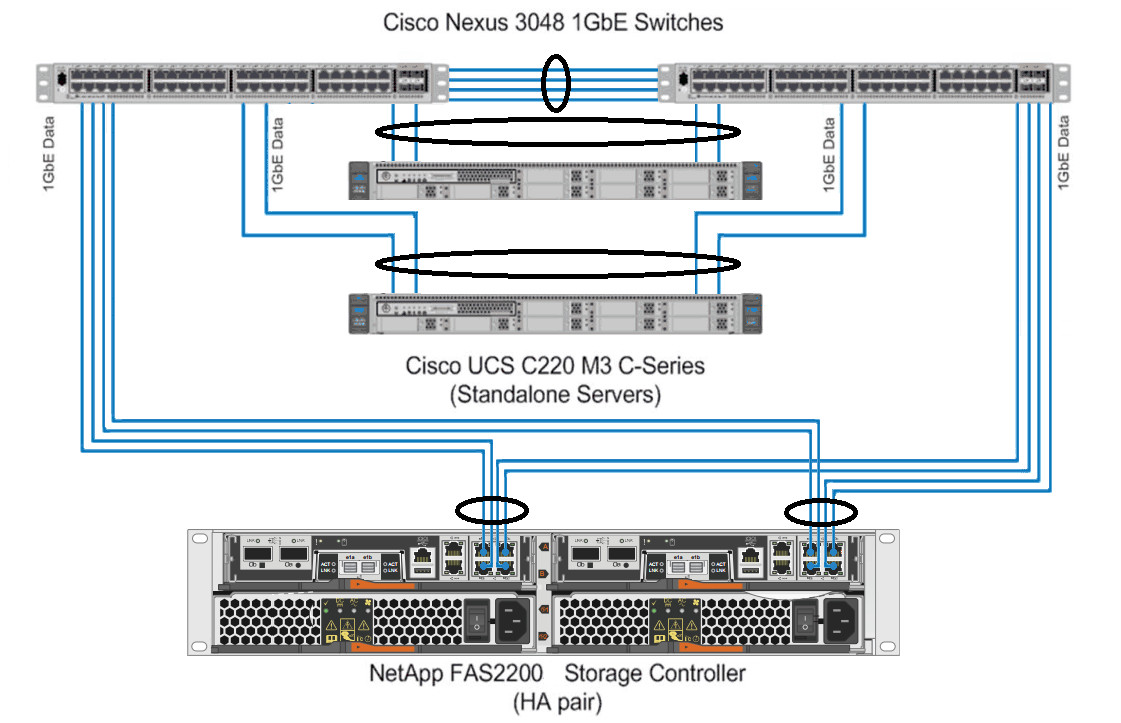

Агрегация каналов и балансировка трафика по IP для СХД

Таким предприятиям очень важно максимально задействовать все доступные технологии, чтобы максимально утилизировать своё оборудование и в этой статье пойдёт речь как этого добиться.

В большинстве современных серверов на борту как правило присутствует минимум два 1Gb интерфейса под данные и один 100Mb для менеджмента.

На СХД младшей серии NetApp FAS2240/FAS2220 на борту каждого контроллера помимо прочего присутствует 4х 1Gb порта.

Т.е. вполне логично использовать схему, где два свича в стеке используют Multi-chassis EtherChannel агрегируя линки идущие от каждого контроллера в каждый свитч для получения как отказоустойчивости так и утилизации пропускной способности всех этих линков. Такая-себе архитектура по образу и подобию FlexPod Express, но без модно-дорогой фичи vPC как у свитчей компании Cisco серии Nexus, в таком случае вместо интерлинков просто будет использован стек свичей. Да и вообще сервера и свитчи в такой схеме могут быть любого производителя. А если совсем всё туго с бюджетом, то можно использовать прямое включение в сервера, так если у сервера 2 порта на борту, можно будет подключить 4-ре сервера, а когда нужно будет добавить 5-й сервер, тут уж прийдётся покупать свитчи.

Схема подключения FlexPod Express.

VMware ESXi 5.Х и NetApp ONTAP 8: тюнинг

Настройки VMWare ESXi можно разделить на следующие части:

- Оптимизация гипервизора

- Оптимизация гостевой ОС (GOS)

- Оптимальные настройки SAN (FC/FCoE и iSCSI)

- Настройки NAS (NFS)

- Проверка совместимости оборудования, прошивок и ПО

Для поиска узкого места обычно выполняют методику последовательного исключения. Предлагаю перво-наперво начать с СХД. А дальше двигаться СХД -> Сеть (Ethernet / FC) -> Хост ( Windows / Linux / VMware ESXi 5.Х и ESXi 6.X ) -> Приложение.

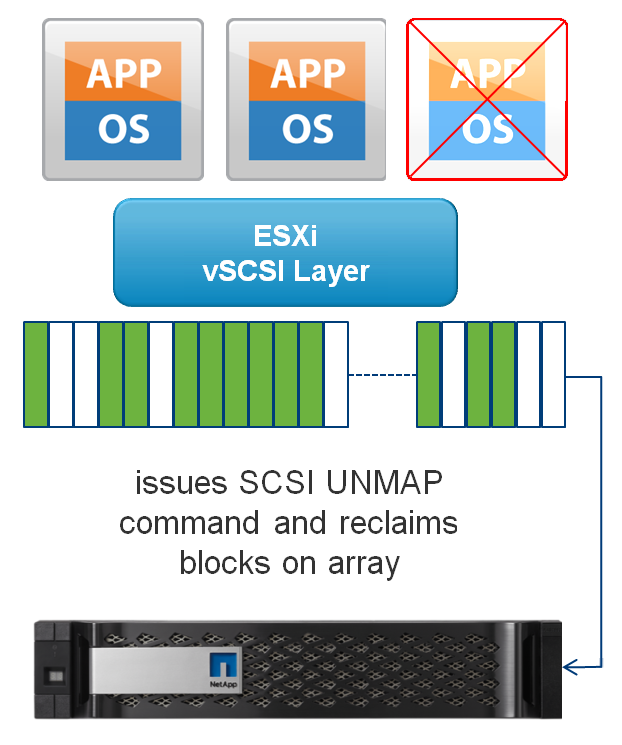

NetApp ONTAP: UNMAP в SAN окружении

Без поддержки команды UNMAP любой тонкий лун созданный на стороне СХД всегда мог только увеличиваться в размере. Его рост был вопросом времени, который безоговорочно всегда заканчивался тем, что такой тонкий лун в конце концов станет занимать свой полный объём, который ему положен, т.е. в конце концов он станет толстым.

NetApp virtual storage appliance: Data ONTAP-v

NetApp ONTAP & ESXi 6.х tuning

Эта статья будет полезна владельцам систем хранения с ONTAP, а часть про Disk Alignment будет полезна не только владельцам NetApp`а.

Настройки VMWare ESXi 6.X можно разделить на следующие части:

- Оптимизация гипервизора

- Оптимизация гостевой ОС (GOS)

- Оптимальные настройки SAN (FC/FCoE и iSCSI)

- Настройки NAS (NFS)

- Проверка совместимости оборудования, прошивок и ПО

Для поиска узкого места обычно выполняют методику последовательного исключения. Предлагаю перво-наперво начать с СХД. А дальше двигаться СХД -> Сеть (Ethernet / FC) -> Хост ( Windows / Linux / VMware ESXi ) → Приложение.